Sono l'elemento fondamentale di una macchina digitale, quello responsabile della cattura dell’immagine. Potremmo dire che è l’equivalente della pellicola per una macchina a pellicola, non fosse che non possiamo cambiarlo a piacimento.

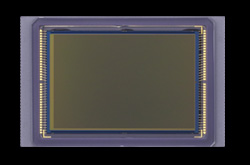

Il sensore della Canon EOS 20D visto attraverso il bocchettone porta ottiche

I parametri fondamentali di un sensore sono la sua dimensione, la spaziatura tra i pixel e il numero di pixel (orizzontali, verticali e totali).

Il Numero dei pixel (ho la 10 Megapixel, evvai!) ci attira quando leggiamo le specifiche. Ma non ci dice tutto. Quello che conta, oltre al numero, è anche la dimensione dei pixel e la dimensione del sensore. C’è, infatti, un intervallo ottimale per le dimensioni dei pixel e ci sono dei vantaggi per i sensori grandi.

Teniamo a mente alcuni numeri che ci saranno utili in seguito: la diagonale del sensore è di 43 mm per il pieno fotogramma, 26 mm per l’APS – C, 11 mm o meno per le compatte digitali.

Il sensore della Canon EOS 5D

dove Sp è la spaziatura dei pixel.

Questo difetto si manifesta come un effetto Moirè su immagini con struttura ripetitiva come tessuti o griglie. Si riduce tagliando le frequenze elevate con un filtro antialiasing che, essendo un filtro passa basso, riduce leggermente la risoluzione del sensore . Questo filtro è indispensabile e costoso. In realtà, se il gruppo ottico e il sensore non sono in grado di avere valori elevati di MTF alla frequenza di Nyquist, allora il filtro non è necessario. E’ questo il motivo per cui le compatte digitali, che hanno pixel da meno di 4 µm non lo usano. Ovviamente le reflex hanno pixel grandi e obiettivi di elevata qualità, per cui l’utilizzo del filtro è inevitabile.

Sensori piccoli hanno problemi con la diffrazione dell’ottica. L’effetto si manifesta ad aperture del diaframma differenti, a seconda della dimensione del sensore. Il formato 35mm (43 mm di diagonale) presenta limitazioni alla risoluzione a partire da f/16. Il sensore APS-C (circa 26 mm di diagonale) presenta limitazioni a partire da f/11 mentre un sensore da 11 mm di diagonale ha limitazioni già a partire da f/4 – f/5.6. Oltretutto gli obiettivi hanno limitazioni dovute alle aberrazioni, che si manifestano ad aperture elevate (f/2.8 – f/4). C’è quindi un intervallo di aperture che da le massime prestazione dal punto di vista della risoluzione. E’ questo il motivo per cui sulle compatte il diaframma chiude al massimo a valori tra f/5.6 ed f/8 e le lenti sono molto corrette per lavorare a tutta apertura. Inoltre, con queste macchine, non ci sono nemmeno problemi di profondità di campo, che è elevatissima grazie anche alla ridotta focale dell’obiettivo. Nelle compatte digitali i sensori hanno diagonali tra 5 e 11 mm e distanza tra i pixel al massimo di 4 µm. Questi modelli hanno rumore accettabile a bassi valori ISO e permettono di produrre delle buonissime stampe 20 x 30 o anche 30 x 45. Nel momento che i pixel diventano più piccoli di 2 µm, la qualità complessiva d’immagine decresce sia per il rumore che per la diffrazione.

Sensori grandi costano di più, non c’è dubbio. Il problema è la resa nel processo di fabbricazione. Un sensore da 11 mm di diagonale ha un’area che è 1/16 quella di un sensore a pieno fotogramma (43 mm, full frame). Immaginiamo che il processo di fabbricazione dia un risultato di 90% dei sensori senza difetti per quello da 11 mm. Quello da 43 mm, 16 volte l’area, avrà un risultato pari a 0,90^16 = 0,18. E il 18% non è un gran risultato, praticamente va bene un elemento ogni cinque! Una delle soluzioni per aumentare la resa è quella di fare pixel più grandi. Non dovendo quindi integrare 16 volte i pixel del sensore più piccolo, la resa aumenta.

La dimensione ottima per I pixel sembra essere tra i 6 e i 9 µm. Pixel più larghi hanno problemi di aliasing e non possono sfruttare a pieno ottiche eccellenti. Pixel più piccoli mostrano più rumore e meno gamma tonale e sensibilità. Affermare che i pixel rimarranno tra i 6 e i 9 µm e che i sensori evolveranno verso il 24 x 36, con numero di pixel tra i 16 ei 20 milioni, non è un’eresia, anzi è già, in parte, realtà.

Tuttavia macchine di questo tipo hanno una qualità pari a quelle medio formato a pellicola e allora la domanda è: per noi che abbiamo sempre fotografato con una reflex 35 mm e stampato fino al 30 x 45 cm, vale la pena avere questa qualità superiore? Per un professionista non ci sono dubbi ma per un dilettante, per quanto evoluto? Ognuno risponda per se.

Tecnologie costruttive

Due tecnologie sono utilizzate per

produrre I sensori: CCD (charge coupled device) e CMOS (complementary metal

oxide semiconductor, un processo utilizzato per produrre I chip per i computer).

Inizialmente i CMOS venivano utilizzati poco per via che avevano una quantità

superiore di rumore intrinseco. Canon, con la sua EOS D30 del 2000, ha

dimostrato che si possono ottenere eccellenti risultati. Se aggiungiamo consumi

minori ed un processo di fabbricazione consolidato (è lo stesso dei chip per

computer) non possiamo che prevedere presente e futuro rosei.

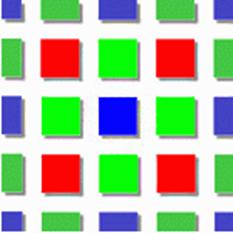

Ci sono due tipi di sensori: quelli che usano il filtro di Bayer e i Foveon, in cui il sensore è composto da tre strati sensibili, ognuno ad un colore RGB. Il primo tipo ha bisogno di interpolazione per creare l’immagine finale, il secondo la produce senza interpolazione. Qual è il migliore? Sulla carta il Foveon sembra non avere rivali, a parità di pixel. In realtà Canon ha dimostrato come non sempre la teoria diventa un ottimo prodotto industriale, tanti sono i parametri in gioco.

Il filtro a mosaico di Bayer

I sensori convenzionali hanno I

pixel disposti in un modo particolare, conosciuto come maschera di Bayer (o

filtro, o mosaico, o filtro a mosaico o Color Filter Array,

CFA), con due pixel Verdi per ogni verde e ogni blu. Questo consegue dalla

sensibilità dell’occhio umano che è più alta verso il verde.

Filtro di Bayer

Con il filtro di Bayer abbiamo una (leggera) perdita di risoluzione e possibilità di effetto Moirè dovuto all’interpolazione che serve a ricostruire i due colori mancanti ad ogni pixel del sensore. I pixel rossi e blu sono spaziati il doppio di quelli verdi (sono la metà) e quindi la loro risoluzione è la metà del verde. Un algoritmo sofisticato ricostruisce l’immagine e la fornisce a 24 bit (8 bit per colore). Vediamo un esempio: una EOS 300D, 6 megapixel, fornisce un file Raw da circa 8 megabyte (6 megapixel a 12 bit, compressione senza perdita). Questo file viene trasformato in un file a 24 bit (8 per canale colore) da circa 18 megabyte o un file da circa 40 megabyte a 48 bit (16 per canale colore)

I migliori algoritmi di interpolazione sono iterativi e quindi molto pesanti da elaborare. E’ ovvio che vengano elaborate meglio in un computer a partire da un file Raw. Gli algoritmi di interpolazione delle fotocamere sono meno sofisticati, i loro elaboratori meno potenti e quindi c’è più rischio di non sfruttare al massimo le potenzialità della macchina.

©2006 Aristide Torrelli